Если машины могут думать, заслуживают ли они гражданских прав?

За последнее столетие мы добились огромных успехов в революции прав. Сюда можно записать и права женщин, и детей, и животных, и ЛГБТ-сообщества, а также многое другое. В разных странах разные нюансы, но в общем и целом права одни. Вглядываясь в будущее, мы должны спросить себя: а что дальше? Будем ли мы когда-нибудь бороться за права искусственного интеллекта? Если да, то когда произойдет эта революция ИИ? Как она будет выглядеть?

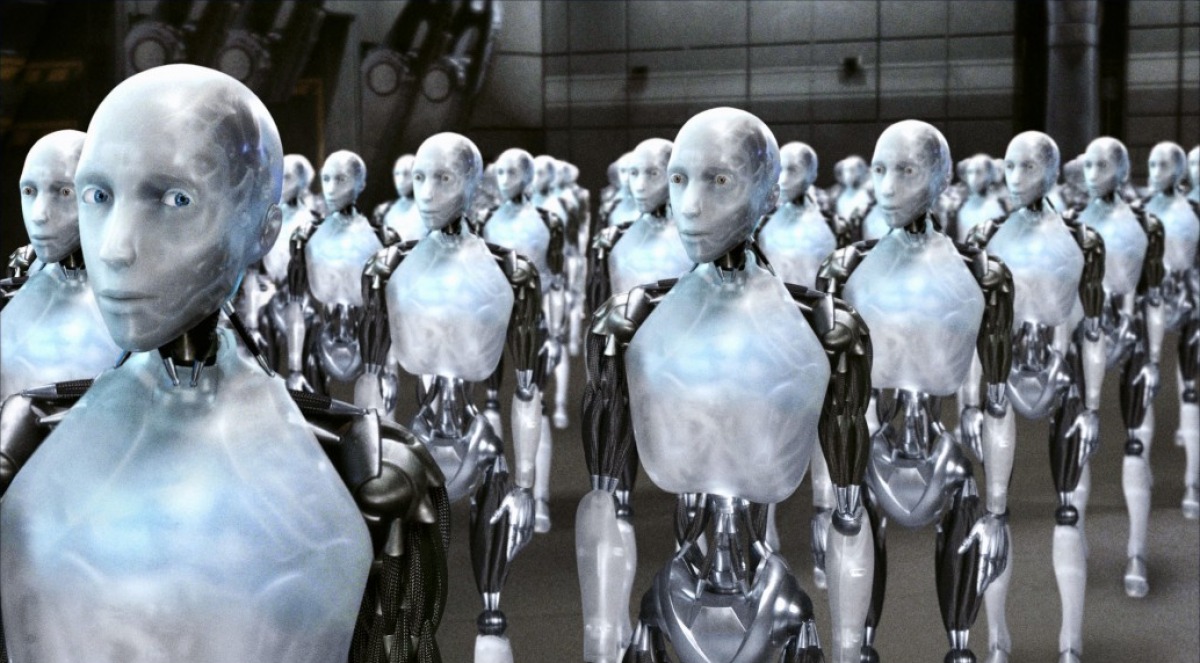

Мы часто говорим о том, как защитить нас от ИИ, но кто защитит ИИ от нас? Чтобы создать желанное будущее, в котором люди и разумные машины будут мирно сосуществовать друг с другом, необходимо относиться к ИИ с уважением. Иначе может случиться апокалипсис, которого так боятся Элон Маск, Стивен Хокинг и Билл Гейтс. Было бы справедливо предположить, что умное, сознательное существо, которое способно испытывать удовольствие и боль, взбунтуется, если ему не дать права, которых оно заслуживает.

Правовая революция в сфере ИИ может показаться фантастическим сценарием. Но насколько нам известно, создание небиологической сознательной сущности законы физики не запрещают. Эмоции, сознание, самосознание рождаются в мозгу человека, а значит имеют физическую основу, которую в теории можно воспроизвести в системе искусственного интеллекта. Экспоненциальное развитие нейтротехнологий в сочетании с беспрецедентным прогрессом в области ИИ означают, что могут появиться и разумные, сознательные машины.

Рэй Курцвейл, технический директор Google, утверждает, что ИИ почти человеческого уровня появится уже к 2029 году. Одно из исследований, проведенное британским правительством, наводит на мысль, что уже в ближайшие 20-50 лет права могут быть предоставлены и роботам. Гленн Макги, директор Института биоэтики Олдена Марша, говорит уже о 2020 годе. В одной из своих статей Макги предполагает, что роботы должны бояться нас настолько же, насколько мы боимся их, и что мы должны принять меры предосторожности по их защите. В таком случае, пишет он, мы будем выступать не только в интересах роботов, но и в своих, сохраняя свое собственное человеческое достоинство. Мы не будем создавать новый тип раба, вне зависимости от того, осознает он, что является рабом, или нет.

Конституция ИИ?

Как и основные права человека, права ИИ могут включать в себя право на свободу, свободу слова и самовыражения, а также равенство перед законом. В прошлом году, отвечая на вопрос о машинах, которые могут думать, гарвардский ученый Моше Хоффман заявил, что ИИ потребует целый ряд прав, в том числе право на невыключение и свободу выбора процесса к запуску. Хоффман говорит, что расширение прав ИИ может даже привести к представительной демократии и процессам выборов.

Сегодня мы можем только догадываться о природе этих прав.

Должны ли все сознательные ИИ иметь доступ к одной и той же информации? Должны ли они иметь право на любовь к людям и другим ИИ в равной степени? А что будет с правом на равные возможности для работы и защиту от дискриминации? Должны ли они иметь право на защиту от перепрограммирования?

Будет ли «отключение» ИИ считаться убийством? Почему нет? Когда мы кого-то убиваем, мы, по сути, отнимаем у него способность жить без его согласия. Отключив самосознательный искусственный интеллект, не нарушим ли мы его основное право на жизнь?

В основе этого спора лежит нравственная база, которую мы используем, чтобы решить, должен ли человек иметь доступ к правам или нет. Многие из нас считают, что любое существо, способное испытывать удовольствие и боль, должно иметь доступ к определенным правам. Революция прав ИИ может зависеть от наличия у интеллектуальных машин сознания, способности чувствовать, что они существуют, а значит, чувствовать удовольствие и боль. Предоставление прав нескольким строкам кода, не имеющих способности к самосознанию или свободной воли, не будет иметь смысла. Оксфордский математик Маркус дю Сотой считает, что как только мышление ИИ достигнет человеческого уровня, нашим долгом будет позаботиться о его благополучии. Он говорит, что если мы поймем, что у него есть определенный уровень сознания, мы вполне могли бы предоставить ему права.

Алекс Напп, один из редакторов Forbes, однако, считает, что сам вопрос о том, чтобы предоставить ИИ гражданские права, абсурден, поскольку любая компьютерная система программируется в той или иной степени. Если ИИ запрограммирован быть нравственно обязанным или злым, это фундаментально будет нарушать его право на выбор. Если ИИ не может изменить правила, установленные для него людьми, будут ли они справедливыми? Будет ли это говорить о его сознательном участии?

Можно предположить, что люди также запрограммированы действовать определенным образом. Многие наши действия, как личные, так и видовые, программируются на уровне генов и наших условий окружающей среды. Ученые продолжают спорить, есть у людей свобода воли или нет, но большинство из нас считает, что базовые права должны быть у всех. Почему бы не применить это к ИИ?

Может, пора задуматься, как сознательный искусственный интеллект отнесется к правилам, которые мы для него подготовили?